- Приложение 3 (справочное). Формы выражения и способы установления пределов допускаемых погрешностей средств измерений

- Способы выражения пределов допускаемых погрешностей средств измерений.

- Нормирование погрешностей средств измерений

- Нормирование погрешностей средств измерений

- Классы точности средств измерений

Приложение 3 (справочное). Формы выражения и способы установления пределов допускаемых погрешностей средств измерений

Формы выражения и способы установления пределов допускаемых погрешностей средств измерений

1. Формы выражения пределов допускаемых погрешностей

1.1. Пределы допускаемых погрешностей выражают в зависимости от характера изменения (в пределах диапазона изменений входного (выходного) сигнала) границ абсолютных погрешностей средств измерений конкретного вида, которые оценивают на основании принципа действия, свойств средств измерений, а также их назначения:

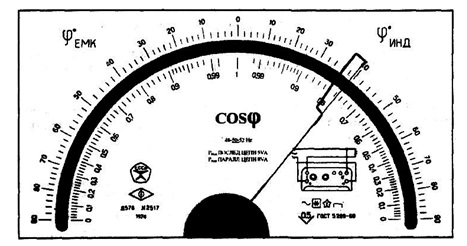

в форме приведенных погрешностей — если указанные границы можно полагать практически неизменными. Например пределы допускаемых погрешностей показывающих амперметров выражают в форме приведенных погрешностей, так как границы погрешностей средств измерений данного вида практически неизменны в пределах диапазона измерений;

в форме относительных погрешностей — если указанные границы нельзя полагать постоянными.

1.2. Пределы допускаемых погрешностей выражают в форме абсолютных погрешностей (т.е. в единицах измеряемой величины или в делениях шкалы средств измерений), если погрешность результатов измерений в данной области измерений принято выражать в единицах измеряемой величины или в делениях шкалы. Например пределы допускаемых погрешностей мер массы (длины) выражают в форме абсолютных погрешностей, так как погрешности результатов измерений массы (длины) принято выражать в единицах массы (длины).

2. Способы установления пределов допускаемых погрешностей

2.1. Пределы допускаемых погрешностей, выраженные в форме абсолютных (относительных) погрешностей, устанавливают одним из следующих способов в зависимости от характера изменения (в пределах диапазона измерений входного (выходного) сигнала) границ погрешностей средств измерений конкретного вида:

по формуле (1) настоящего стандарта — если границы абсолютных погрешностей можно полагать практически неизменными;

по формуле (4) настоящего стандарта — если границы относительных погрешностей можно полагать практически неизменными;

по формуле (2) или (5) настоящего стандарта — если границы абсолютных погрешностей можно полагать изменяющимися практически линейно;

в виде функции, графика или таблицы — если границы погрешностей необходимо принять изменяющимися нелинейно.

Откройте актуальную версию документа прямо сейчас или получите полный доступ к системе ГАРАНТ на 3 дня бесплатно!

Если вы являетесь пользователем интернет-версии системы ГАРАНТ, вы можете открыть этот документ прямо сейчас или запросить по Горячей линии в системе.

Источник

Способы выражения пределов допускаемых погрешностей средств измерений.

Пределом допускаемой погрешности средств измерений называется наибольшее (без учёта знака) его погрешность , при которой это средство может быть признано годным.

Например вольтметр годности 0 (инструментальная погрешность от 0 до +/- 1 %)

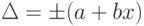

Вопросы нормирования погрешности рассматривает ГОСТ 8.401-80 «КЛАССЫ ТОЧНОСТИ СРЕДСТВ ИЗМЕРЕНИЯ. ОБЩИЕ ТРЕБОВАНИЯ». Согласно этого ГОСТа пределы, допускаемые основной и дополнительной погрешностями, выражаются в форме приведённых абсолютных или относительных погрешностях. Форма представления пределов допускаемой погрешности выбирается отноосительно характера измерения погрешности в пределах диапазона измерений. Пределы допускаемой абсолютной погрешности (∆Х=±а).

Если присутствует аддетивная погрешность, то в эту формулу вводят слагаемое (bx).

Пределы допускаемой приведённой основной погрешности (γ=

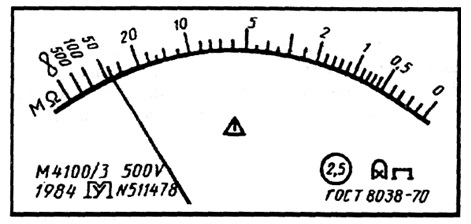

Для измерительных приборов с существенной неравномерной шкалой (например ОММЕТР) нормирующее значение устанавливают равным всей длине шкалы.

Класс точности средств измерения — обобщённая характеристика, определяемая пределами допускаемых основных и дополнительных погрешностей, а также другими свойствами средств измерения, влияющими на точность. Класс точности характеризует свойства средств измерений, в отношении точности, но не является непосредственным показателем точности средств измерения, выполняемых с помощью этого средства измерения.

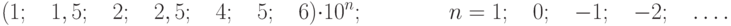

1) Если класс точности установлен по пределу допускаемой относительной погрешности, то на шкале цифра будет находиться в кружочке.

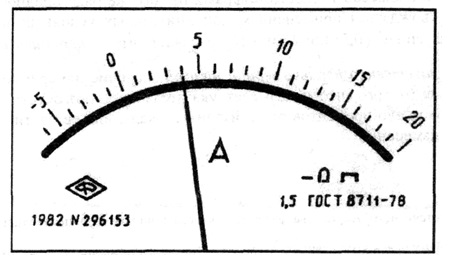

2)Если погрешность прибора признана аддетивной, и прибор нормируется по пределу допускаемой приведённой основной погрешности, то класс точности указывается без кружочков. 3) Если шкала прибора сильно неравномерна, нормирующее значение принято равным длине шкалы, то класс точности обозначается числом в галочке.

Для всех рассмотренных случаев, вместе с условием обозначения класса точности, на шкале, щитке или корпусе измерительного прибора, указывается номер стандарта или ТУ которые устанавливает нормы для средства измерения.

Погрешности измерений.

Погрешность результата измерения – отклонение результата измерения от истинного значения.

Погрешность результата измерения выражается числом, указывающим на возможные границы неопределённости значения измеряемой величины.

По способу такта погрешность результата измерения классифицируется:

— по способу числового выражения (абсолютная, относительная);

— в зависимости от источника возникновения (инструментальные, методические, отсчитывания, установки);

— по закономерностям проявления (систематические, прогрессирующие, случайные, грубые).

Источник

Нормирование погрешностей средств измерений

Нормирование погрешностей средств измерений

Нормирование метрологических характеристик средств измерений и заключается в установлении границ для отклонений реальных значений параметров средств измерений от их номинальных значений.

Каждому средству измерений приписываются некоторые номинальные характеристики. Действительные же характеристики средств измерений не совпадают с номинальными, что и определяет их погрешности.

Обычно нормирующее значение принимают равным:

- большему из пределов измерений, если нулевая отметка расположена на краю или вне диапазона измерения;

- сумме модулей пределов измерения, если нулевая отметка расположена внутри диапазона измерения;

- длине шкалы или её части, соответствующей диапазону измерения, если шкала существенно неравномерна (например, у омметра);

- номинальному значению измеряемой величины, если таковое установлено (например, у частотомера с номинальным значением 50 Гц);

- модулю разности пределов измерений, если принята шкала с условным нулём (например, для температуры), и т.д.

Чаще всего за нормирующее значение принимают верхний предел измерений данного средства измерений.

Отклонения параметров средств измерений от их номинальных значений, вызывающие погрешность измерений, не могут быть указаны однозначно, поэтому для них должны быть установлены предельно допускаемые значения.

Указанное нормирование является гарантией взаимозаменяемости средств измерений.

Нормирование погрешностей средств измерений заключается в установлении предела допускаемой погрешности.

Под этим пределом понимается наибольшая (без учёта знака) погрешность средства измерения, при которой оно может быть признано годным и допущено к применению.

Подход к нормированию погрешностей средств измерений заключается в следующем:

- в качестве норм указывают пределы допускаемых погрешностей, включающие в себя и систематические, и случайные составляющие;

- порознь нормируют все свойства средств измерений, влияющие на их точность.

Стандарт устанавливает ряды пределов допускаемых погрешностей. Этой же цели служит установление классов точности средств измерений.

Классы точности средств измерений

Класс точности – это обобщенная характеристика СИ , выражаемая пределами допускаемых значений его основной и дополнительной погрешностей, а также другими характеристиками, влияющими на точность . Класс точности не является непосредственной оценкой точности измерений, выполняемых этим СИ , поскольку погрешность зависит еще от ряда факторов: метода измерений, условий измерений и т.д. Класс точности лишь позволяет судить о том, в каких пределах находится погрешность СИ данного типа. Общие положения деления средств измерений по классу точности устанавливает ГОСТ 8.401–80.

Пределы допускаемой основной погрешности, определяемые классом точности, – это интервал , в котором находится значение основной погрешности СИ .

Классы точности СИ устанавливаются в стандартах или технических условиях. Средство измерения может иметь два и более класса точности. Например, при наличии у него двух или более диапазонов измерений одной и той же физической величины ему можно присваивать два или более класса точности. Приборы, предназначенные для измерения нескольких физических величин, также могут иметь различные классы точности для каждой измеряемой величины.

Пределы допускаемых основной и дополнительной погрешностей выражают в форме приведенных, относительных или абсолютных погрешностей. Выбор формы представления зависит от характера изменения погрешностей в пределах диапазона измерений, а также от условий применения и назначения СИ .

Пределы допускаемой абсолютной основной погрешности устанавливаются по одной из формул:

В технической документации классы точности, установленные в виде абсолютных погрешностей, обозначают, например, » Класс точности М», а на приборе – буквой «М». Для обозначения используются прописные буквы латинского алфавита или римские цифры, причём меньшие пределы погрешностей должны соответствовать буквам, находящимся ближе к началу алфавита, или меньшим цифрам. Пределы допускаемой приведенной основной погрешности определяются по формуле

Нормирующее значение xN устанавливается равным большему из пределов измерений (или модулей) для СИ с равномерной, практически равномерной или степенной шкалой и для измерительных преобразователей, для которых нулевое значение выходного сигнала находится на краю или вне диапазона измерений. Для СИ , шкала которых имеет условный нуль, равно модулю разности пределов измерений.

Для приборов с существенно неравномерной шкалой xN принимают равным всей длине шкалы или ее части, соответствующей диапазону измерении. В этом случае пределы абсолютной погрешности выражают, как и длину шкалы, в единицах длины, а на средстве измерений класс точности условно обозначают, например, в виде значка

В остальных рассмотренных случаях класс точности обозначают конкретным числом р, например 1,5. Обозначение наносится на циферблат, щиток или корпус прибора (рис. 3.2).

В том случае если абсолютная погрешность задается формулой

| ( 3.1) |

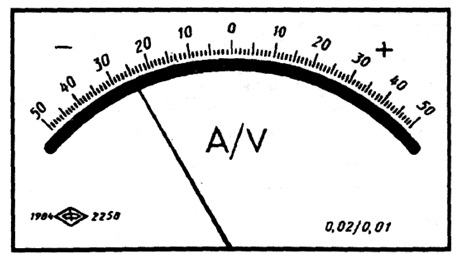

где с, d – отвлеченные положительные числа, выбираемые из ряда:

Пределы допускаемой относительной основной погрешности определяются по формуле

В стандартах и технических условиях на СИ указывается минимальное значение x0, начиная с которого применим принятый способ выражения пределов допускаемой относительной погрешности. Отношение xk/x0 называется динамическим диапазоном измерения.

Правила построения и примеры обозначения классов точности в документации и на средствах измерений приведены в таблице 3.1.

Источник