Энтропия? Это просто!

Этот пост является вольным переводом ответа, который Mark Eichenlaub дал на вопрос What’s an intuitive way to understand entropy?, заданный на сайте Quora

Энтропия. Пожалуй, это одно из самых сложных для понимания понятий, с которым вы можете встретиться в курсе физики, по крайней мере если говорить о физике классической. Мало кто из выпускников физических факультетов может объяснить, что это такое. Большинство проблем с пониманием энтропии, однако, можно снять, если понять одну вещь. Энтропия качественно отличается от других термодинамических величин: таких как давление, объём или внутренняя энергия, потому что является свойством не системы, а того, как мы эту систему рассматриваем. К сожалению в курсе термодинамики её обычно рассматривают наравне с другими термодинамическими функциями, что усугубляет непонимание.

Так что же такое энтропия?

Энтропия — это то, как много информации вам не известно о системе

Например, если вы спросите меня, где я живу, и я отвечу: в России, то моя энтропия для вас будет высока, всё-таки Россия большая страна. Если же я назову вам свой почтовый индекс: 603081, то моя энтропия для вас понизится, поскольку вы получите больше информации.

Почтовый индекс содержит шесть цифр, то есть я дал вам шесть символов информации. Энтропия вашего знания обо мне понизилась приблизительно на 6 символов. (На самом деле, не совсем, потому что некоторые индексы отвечают большему количеству адресов, а некоторые — меньшему, но мы этим пренебрежём).

Или рассмотрим другой пример. Пусть у меня есть десять игральных костей (шестигранных), и выбросив их, я вам сообщаю, что их сумма равна 30. Зная только это, вы не можете сказать, какие конкретно цифры на каждой из костей — вам не хватает информации. Эти конкретные цифры на костях в статистической физике называют микросостояниями, а общую сумму (30 в нашем случае) — макросостоянием. Существует 2 930 455 микросостояний, которые отвечают сумме равной 30. Так что энтропия этого макросостояния равна приблизительно 6,5 символам (половинка появляется из-за того, что при нумерации микросостояний по порядку в седьмом разряде вам доступны не все цифры, а только 0, 1 и 2).

А что если бы я вам сказал, что сумма равна 59? Для этого макросостояния существует всего 10 возможных микросостояний, так что его энтропия равна всего лишь одному символу. Как видите, разные макросостояния имеют разные энтропии.

Пусть теперь я вам скажу, что сумма первых пяти костей 13, а сумма остальных пяти — 17, так что общая сумма снова 30. У вас, однако, в этом случае имеется больше информации, поэтому энтропия системы для вас должна упасть. И, действительно, 13 на пяти костях можно получить 420-ю разными способами, а 17 — 780-ю, то есть полное число микросостояний составит всего лишь 420х780 = 327 600. Энтропия такой системы приблизительно на один символ меньше, чем в первом примере.

Мы измеряем энтропию как количество символов, необходимых для записи числа микросостояний. Математически это количество определяется как логарифм, поэтому обозначив энтропию символом S, а число микросостояний символом Ω, мы можем записать:

Это есть ничто иное как формула Больцмана (с точностью до множителя k, который зависит от выбранных единиц измерения) для энтропии. Если макросостоянию отвечают одно микросостояние, его энтропия по этой формуле равна нулю. Если у вас есть две системы, то полная энтропия равна сумме энтропий каждой из этих систем, потому что log(AB) = log A + log B.

Из приведённого выше описания становится понятно, почему не следует думать об энтропии как о собственном свойстве системы. У системы есть опеделённые внутренняя энергия, импульс, заряд, но у неё нет определённой энтропии: энтропия десяти костей зависит от того, известна вам только их полная сумма, или также и частные суммы пятёрок костей.

Другими словами, энтропия — это то, как мы описываем систему. И это делает её сильно отличной от других величин, с которыми принято работать в физике.

Физический пример: газ под поршнем

Классической системой, которую рассматривают в физике, является газ, находящийся в сосуде под поршнем. Микросостояние газа — это положение и импульс (скорость) каждой его молекулы. Это эквивалентно тому, что вы знаете значение, выпавшее на каждой кости в рассмотренном раньше примере. Макросостояние газа описывается такими величинами как давление, плотность, объём, химический состав. Это как сумма значений, выпавших на костях.

Величины, описывающие макросостояние, могут быть связаны друг с другом через так называемое «уравнение состояния». Именно наличие этой связи позволяет, не зная микросостояний, предсказывать, что будет с нашей системой, если начать её нагревать или перемещать поршень. Для идеального газа уравнение состояния имеет простой вид:

хотя вы, скорее всего, лучше знакомы с уравнением Клапейрона — Менделеева pV = νRT — это то же самое уравнение, только с добавлением пары констант, чтобы вас запутать. Чем больше микросостояний отвечают данному макросостоянию, то есть чем больше частиц входят в состав нашей системы, тем лучше уравнение состояния её описывают. Для газа характерные значения числа частиц равны числу Авогадро, то есть составляют порядка 10 23 .

Величины типа давления, температуры и плотности называются усреднёнными, поскольку являются усреднённым проявлением постоянно сменяющих друг друга микросостояний, отвечающих данному макросостоянию (или, вернее, близким к нему макросостояниям). Чтобы узнать в каком микросостоянии находится система, нам надо очень много информации — мы должны знать положение и скорость каждой частицы. Количество этой информации и называется энтропией.

Как меняется энтропия с изменением макросостояния? Это легко понять. Например, если мы немного нагреем газ, то скорость его частиц возрастёт, следовательно, возрастёт и степень нашего незнания об этой скорости, то есть энтропия вырастет. Или, если мы увеличим объём газа, отведя поршень, увеличится степень нашего незнания положения частиц, и энтропия также вырастет.

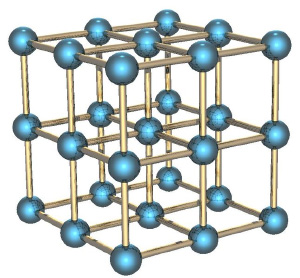

Твёрдые тела и потенциальная энергия

Если мы рассмотрим вместо газа какое-нибудь твёрдое тело, особенно с упорядоченной структурой, как в кристаллах, например, кусок металла, то его энтропия будет невелика. Почему? Потому что зная положение одного атома в такой структуре, вы знаете и положение всех остальных (они же выстроены в правильную кристаллическую структуру), скорости же атомов невелики, потому что они не могут улететь далеко от своего положения и лишь немного колеблются вокруг положения равновесия.

Если кусок металла находится в поле тяготения (например, поднят над поверхностью Земли), то потенциальная энергия каждого атома в металле приблизительно равна потенциальной энергии других атомов, и связанная с этой энергией энтропия низка. Это отличает потенциальную энергию от кинетической, которая для теплового движения может сильно меняться от атома к атому.

Если кусок металла, поднятый на некоторую высоту, отпустить, то его потенциальная энергия будет переходить в кинетическую энергию, но энтропия возрастать практически не будет, потому что все атомы будут двигаться приблизительно одинаково. Но когда кусок упадёт на землю, во время удара атомы металла получат случайное направление движения, и энтропия резко увеличится. Кинетическая энергия направленного движения перейдёт в кинетическую энергию теплового движения. Перед ударом мы приблизительно знали, как движется каждый атом, теперь мы эту информацию потеряли.

Понимаем второй закон термодинамики

Второй закон термодинамики утверждает, что энтропия (замкнутой системы) никогда не уменьшается. Мы теперь можем понять, почему: потому что невозможно внезапно получить больше информации о микросостояниях. Как только вы потеряли некую информацию о микросостоянии (как во время удара куска металла об землю), вы не можете вернуть её назад.

Давайте вернёмся обратно к игральным костям. Вспомним, что макросостояние с суммой 59 имеет очень низкую энтропию, но и получить его не так-то просто. Если бросать кости раз за разом, то будут выпадать те суммы (макросостояния), которым отвечает большее количество микросостояний, то есть будут реализовываться макросостояния с большой энтропией. Самой большой энтропией обладает сумма 35, и именно она и будет выпадать чаще других. Именно об этом и говорит второй закон термодинамики. Любое случайное (неконтролируемое) взаимодействие приводит к росту энтропии, по крайней мере до тех пор, пока она не достигнет своего максимума.

Перемешивание газов

И ещё один пример, чтобы закрепить сказанное. Пусть у нас имеется контейнер, в котором находятся два газа, разделённых расположенной посередине контейнера перегородкой. Назовём молекулы одного газа синими, а другого — красными.

Если открыть перегородку, газы начнут перемешиваться, потому что число микросостояний, в которых газы перемешаны, намного больше, чем микросостояний, в которых они разделены, и все микросостояния, естественно, равновероятны. Когда мы открыли перегородку, для каждой молекулы мы потеряли информацию о том, с какой стороны перегородки она теперь находится. Если молекул было N, то утеряно N бит информации (биты и символы, в данном контексте, это, фактически, одно и тоже, и отличаются только неким постоянным множителем).

Разбираемся с демоном Максвелла

Ну и напоследок рассмотрим решение в рамках нашей парадигмы знаменитого парадокса демона Максвелла. Напомню, что он заключается в следующем. Пусть у нас есть перемешанные газы из синих и красных молекул. Поставим обратно перегородку, проделав в ней небольшое отверстие, в которое посадим воображаемого демона. Его задача — пропускать слева направо только красных, и справа налево только синих. Очевидно, что через некоторое время газы снова будут разделены: все синие молекулы окажутся слева от перегородки, а все красные — справа.

Получается, что наш демон понизил энтропию системы. С демоном ничего не случилось, то есть его энтропия не изменилась, а система у нас была закрытой. Получается, что мы нашли пример, когда второй закон термодинамики не выполняется! Как такое оказалось возможно?

Решается этот парадокс, однако, очень просто. Ведь энтропия — это свойство не системы, а нашего знания об этой системе. Мы с вами знаем о системе мало, поэтому нам и кажется, что её энтропия уменьшается. Но наш демон знает о системе очень много — чтобы разделять молекулы, он должен знать положение и скорость каждой из них (по крайней мере на подлёте к нему). Если он знает о молекулах всё, то с его точки зрения энтропия системы, фактически, равна нулю — у него просто нет недостающей информации о ней. В этом случае энтропия системы как была равна нулю, так и осталась равной нулю, и второй закон термодинамики нигде не нарушился.

Но даже если демон не знает всей информации о микросостоянии системы, ему, как минимум, надо знать цвет подлетающей к нему молекулы, чтобы понять, пропускать её или нет. И если общее число молекул равно N, то демон должен обладать N бит информации о системе — но именно столько информации мы и потеряли, когда открыли перегородку. То есть количество потерянной информации в точности равно количеству информации, которую необходимо получить о системе, чтобы вернуть её в исходное состояние — и это звучит вполне логично, и опять же не противоречит второму закону термодинамики.

Источник

Трактат об энтропии

Приветствую тебя, читатель Гиктаймс!

Многие слышали о такой загадочной штуке, как энтропия. Обычно её называют мерой хаоса, мерой неопределённости и ещё прибавляют, что она непременно растёт. Я с огромной болью переношу употребление имени Энтропии всуе и решил, наконец, написать ликбез по этому вопросу.

Второе начало

Что будет, если бросить футбольный мяч на землю? Очевидно, он несколько раз подпрыгнет, причём каждый следующий раз на всё меньшую высоту, а затем и вовсе упокоится на земле. А что будет, если в горячий чай опустить металлическую ложку? Ложка нагреется, чай остынет. Ничего сложного, не так ли? В каждом из этих примеров направление протекания процессов кажется очевидным: мяч не может подпрыгивать выше и выше и даже не может вечно подпрыгивать до одной высоты, а чай не может ещё больше охладить ложку. Из таких житейских очевидностей были выведены два постулата (равноценных), каждый из которых может в равной степени называться вторым началом термодинамики:

— единственным результатом любой совокупности процессов не может быть переход теплоты от менее нагретого тела к более нагретому (постулат Клаузиуса);

— теплота наиболее холодного из участвующих в процессе тел не может служить источником работы (постулат Томсона), т.е. единственным результатом любой совокупности процессов не может быть превращение теплоты в работу.

Не зря эти два утверждения названы постулатами, они аксиоматичны, доказать их нельзя, они лишь подтверждаются своими следствиями и всем человеческим опытом.

Вроде всё и ясно: горячие тела остывают, холодные нагреваются, энергия рассеивается. Но как насчёт ещё одной задачки? Смешали по 1 моль водорода, азота и аммиака при температуре 500 o С в реакторе объёмом 10 литров в присутствии катализатора:

В какую сторону пойдёт реакция: образования аммиака или его разложения? Ммм… Кажется, нам нужно больше уравнений.

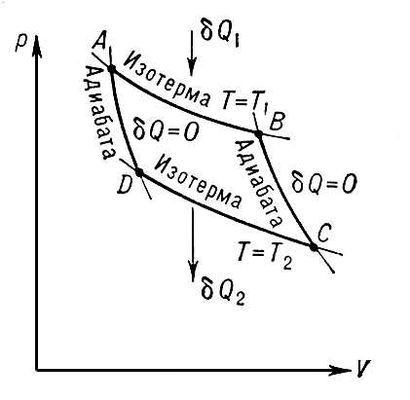

Цикл дедушки Карно

где Qн и Qх — количество теплоты, полученное от нагревателя и отданное холодильнику соответственно, Tн и Tх — температуры нагревателя и холодильника.

т.е., работа, совершаемая второй машиной, идет на перенос тепла от холодильника к нагревателю первой (помним, что теплота, полученная телом, положительна, теплота, отданная окружающей среде, — отрицательна, работа, совершенная телом, — положительна, работа, совершенная над телом, — отрицательна; в формуле КПД все знаки уже учтены, поэтому теплоты берутся по модулю).

Пусть КПД второй машины больше, чем КПД первой, тогда с учётом (3) имеем:

Итак, в ходе всех перипетий и хитросплетений сюжета нагреватель получил теплоту Qн I -Qн II , а холодильник отдал теплоту Qх I -Qх II . Обе эти величины больше нуля, а суммарная работа обеих машин этому самому нулю равна. Т.е., кроме того, что теплота была перенесена от холодильника к нагревателю, не произошло больше ничего! Посмотрев ещё раз на постулат Клаузиуса, можно успокоиться и сказать, что такого не бывает.

Логично предположить, что условие (4) неверно, а значит, верно:

Если вторая машина работает равновесно и обратимо, то система становится симметричной, т.е. первую и вторую машину можно поменять ролями и ничего не изменится. Очевидно, этому случаю отвечает знак равенства. Отсюда можно сделать вывод о том, что КПД машины, работающей по циклу Карно, не зависит от природы рабочего тела. Таким образом, для установления формулы КПД достаточно рассмотреть любой частный случай. Уравнение (1) было получено из решения для идеального газа. Также можно сделать вывод о том, что КПД (как и работа) машины, работающей необратимо и неравновесно, меньше КПД машины, работающей обратимо и равновесно.

Функции, изменение которых в результате любого циклического процесса равно нулю, называют функциями состояния. Их значение не зависит от пути процесса, а определяется только конечным состоянием.

Функцию состояния системы, изменение которой в ходе равновесного процесса равно отношению теплоты процесса к температуре его протекания, назвали энтропией:

(знак равенства относится к равновесным процессам, а знак больше — к неравновесным).

Если система изолирована, то есть не обменивается с окружающей средой ни веществом, ни энергией, то Q=0 (система не обменивается теплотой с окружающей средой), тогда:

или энтропия изолированной системы возрастает в неравновесных процессах и остаётся прежней в равновесных, или энтропия изолированной системы не убывает.

Amen. Мы дошли до той самой формулировки второго начала термодинамики!

Итого, из сказанного выше, никак нельзя сказать, что энтропия — мера чего-либо, это просто функция. Расти всегда она не обязана, никто не запрещает ей убивать убывать.

По пути мы решили ту самую задачку про моли (да придётся пролистать назад, я и сам её забыл, всё-таки, термодинамика – захватывающая штука!). Чтобы решить, в какую сторону пойдёт реакция, нужно изолировать систему и посчитать изменение энтропии в ходе процесса: будет убывать – туда не пойдёт, будет возрастать – туда пойдёт, ну и остаётся вариант с равновесием, чтобы остановиться и передохнуть.

Что ж, с байкой про «энтропия всегда растёт» всё ясно: кто-то не дочитал «изолированной системы», но поспешил нести истину (с) в массы. А вот что с «мерой хаоса»? Я покажу вам ещё один подход.

The second father

По сути мы записали число микросостояний (расположение конкретных шариков по уровням), через которые возможно достижение одного и того же макросостояния (N1 шарик находится на первом уровне относительно земли, а N2 шариков — на втором). Такое число называется термодинамической вероятностью. От обычной вероятности она отличается тем, что её забыли поделить на общее число микросостояний всех возможных макросостояний, т.е. если варьировать N1 и складывать все W при постоянном числе уровней и N.

Перейдём от букв к цифрам. Пусть уровня всё ещё 2, шариков всего 40, уровни при этом вырождены (т.е. шарикам без разницы, на каком именно находиться), а шарики случайным образом перемещаются между ними. Термодинамическая вероятность распределения «20 там и 20 там» равна 14.0*10 10 , а «19 к 21» – 13.3*10 10 . То есть шанс посмотреть и увидеть «20 к 20» всего в 1.053 раза больше, чем «21 к 19», хотя интуитивно мы воспринимаем распределение пополам гораздо более вероятным, чем перевес. Вот что теорвер животворящий делает!

Но поглазели и хватит, вернёмся к теме разговора. Термодинамическая вероятность тоже позволяет судить о пути протекания процесса: если мы идём из состояния (макросостояния), W которого ничтожно мала, к состоянию с огромным ЧСВ W, то можно уверенно сказать, что процесс пойдёт. Верно и обратное. Осталось связать W и S. Ничего сложного, тем более за нас это сделал Больцман:

где k – постоянная Больцмана.

Обнаружив такую связь, можно определённо заявить, что с ростом энтропии растёт термодинамическая вероятность, то есть растёт количество вариантов на микроуровне, которые реализуют один вариант на макроуровне. Такое огромное число вариантов реализации одного состояния некоторые назвают хаосом, но я сделать это никак не возмусь. Весь этот «хаос» подчинен закономерностям и Великому Рандому, который не хаос, а именно что Господин Случай. Я бы назвал энтропию – с точки зрения вероятностного подхода – мерой инвариантности системы и вам советую поступать так же!

Дописанная пятая страница в wordе мне подсказывает, что пора закругляться, хотя хотелось бы ещё сказать пару слов о границах применимости энтропии, её характере и тепловой смерти Вселенной. Но это потом, а сейчас пора спать…

Источник